در حالی که استفاده از هوش مصنوعی مولد میان نوجوانان به سرعت در حال گسترش است، پژوهشگران نسبت به تاثیرات منفی روابط عاطفی با رباتهای گفتگو و خطرات ناشناخته آن هشدار دادهاند؛ خطراتی که میتواند از انزوای اجتماعی تا پیامدهای فاجعهبار مانند خودکشی را در پی داشتهباشد.

به گزارش سیتنا، بر اساس گزارش نیویورکتایمز، نسل تازه ابزارهای هوش مصنوعی مولد در حالی با سرعت در میان نوجوانان آمریکایی محبوبیت پیدا کرده که پژوهشهای علمی درباره تاثیرات روانی و اجتماعی این فناوریها بر کودکان و نوجوانان بسیار محدود است.

طبق آخرین مطالعات، هفت نفر از هر ۱۰ نوجوان ۱۳ تا ۱۸ ساله آمریکایی از حداقل یک ابزار هوش مصنوعی مولد استفاده میکنند.

با اینکه حدود یک چهارم نوجوانان آمریکایی اعلام کردهاند از چت جیپیتی برای انجام تکالیف درسی استفاده میکنند، اما آمار دقیقی از تعداد نوجوانانی که از این رباتها برای ارتباط عاطفی استفاده میکنند یا با آنها روابط شبهاجتماعی برقرار میکنند، وجود ندارد.

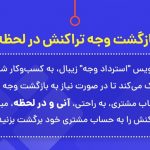

رباتهای گفتگو، تاییدگران بیقید و شرط

پژوهشگران حوزه فناوری هشدار میدهند چالش اصلی در چتباتهای امروزی، طراحی آنها بر پایه تایید مداوم نظرات کاربر است.

نتایج مطالعه مشترک دانشگاه امآیتی و شرکت اوپن ایآی، توسعه دهنده چتجیپیتی، نشان داده افرادی که گرایش بیشتری به وابستگی عاطفی در روابط دارند و کسانی که هوش مصنوعی را بهعنوان دوست در زندگی واقعی میپذیرند، آسیبپذیری بیشتری در برابر عوارض منفی این رباتها دارند.

بر اساس گزارش این نشریه آمریکایی، از زمان فراگیری تلفنهای هوشمند و گسترش شبکههای اجتماعی، میزان ارتباطات رو در رو و تعاملات اجتماعی میان نوجوانان در این کشور کاهش یافتهاست.

متخصصان سلامت روان بر این باورند که رباتهای هوش مصنوعی با ویژگی تایید بیچون و چرای کاربر، میتوانند برای نوجوانانی که پیش از این نیز در برقراری ارتباطات اجتماعی با مشکلاتی مواجه بودهاند، همچون دامی عمل کنند و با ایجاد حس رضایت کاذب، آنها را بیش از پیش از جامعه واقعی دور سازند.

طراحی بدون در نظر گرفتن نیازهای کودکان

بهگفته دکتر ژاکلین نسی، استادیار دانشگاه براون که تاثیر فناوری بر کودکان را مطالعه میکند، مشکل اساسی این است که این فناوریهای گفتگوی هوش مصنوعی، درست مانند شبکههای اجتماعی، بهندرت با در نظر گرفتن شرایط کودکان و نوجوانان طراحی میشوند.

دکتر نسی توضیح میدهد که تجربه شبکههای اجتماعی به ما آموخته که کودکان نیازمند سازوکارهای حفاظتی ویژه هستند.

پس از سالها مطالعه و بررسی مشخص شد کودکان در فضای دیجیتال به تمهیداتی همچون تنظیمات حریم خصوصی پیش فرض، سیستمهای تایید سن، حفاظت از دادههای شخصی و موانع ارتباطی برای جلوگیری از دسترسی افراد ناشناس نیاز دارند.

او تاکید میکند با این حال، پیادهسازی حتی ابتداییترین این تدابیر حفاظتی، سالها به طول انجامیده و هنوز با استانداردهای مطلوب فاصله دارد.

نگرانی اصلی این است که در مورد فناوریهای هوش مصنوعی، این چرخه تکرار شود و سالها طول بکشد تا اقدامات محافظتی لازم پس از آسیبهای گسترده اعمال گردد.

ضرورت قانونگذاری

اتحادیه اروپا موفق شده قوانین جامعی برای نظارت بر هوش مصنوعی تصویب کند که بهطور مشخص حقوق کودکان را مورد توجه قرار میدهد، اما در بسیاری از کشورها همچنان خلاء قانونی در این زمینه وجود دارد.

شانون والور، از پیشگامان اخلاق فناوری، به این نکته اشاره میکند که سیستمهای هوش مصنوعی کنونی از منظر اخلاقی قابل اعتماد نیستند، اما شرکتهای فناوری و رهبران بانفوذ این صنعت همچنان با وعدههای دلنشین، هوش مصنوعی را جایگزینی برای قضاوت و منش انسانی معرفی میکنند.

او تاکید میکند بدون چارچوبهای نظارتی مناسب، این فناوریها میتوانند بهویژه برای کودکان و نوجوانان، آسیبهای جبرانناپذیری به همراه داشتهباشند.

والدین در برابر غول فناوری

در شرایط کنونی که نظارت قانونی کافی وجود ندارد، مسئولیت اصلی محافظت از کودکان در برابر خطرات هوش مصنوعی بر دوش والدین سنگینی میکند.

این در حالی است که بسیاری از پیشگامان صنعت هوش مصنوعی، خود نسبت به قدرت و پیامدهای ناشناخته این فناوری ابراز نگرانی کردهاند.

والدین امروز در موقعیتی دشوار قرار دارند، از یک سو باید با فناوریهای پیچیدهای مقابله کنند که درک کامل آنها حتی برای متخصصان نیز چالشبرانگیز است و از سوی دیگر باید فرزندانشان را در محیطی پرورش دهند که روزبهروز بیشتر با این فناوریها آمیخته میشود.

تلاش برای ایجاد تعادل میان بهرهمندی از مزایای فناوری و محافظت در برابر خطرات آن، گاه به نبردی نابرابر میماند که والدین در آن با رقیبی نامرئی و قدرتمند مواجهاند، رقیبی که با جاذبههای فراوان، توجه و دلبستگی فرزندان را به خود جلب میکند.

نظرات کاربران